Já imaginou tentar entrar numa festa exclusiva, mas ser barrado logo na entrada porque seu rosto é conhecido? Essa é a sensação quando fazemos web scraping sem a proteção adequada. O site bloqueia ou dificulta o acesso ao detectar múltiplas requisições do mesmo IP, frustrando o processo.

Um dado interessante: estima-se que 60% dos projetos de web scraping enfrentam bloqueios severos logo no início. Proxy para web scraping como funciona é fundamental para driblar essas barreiras e garantir a eficiência na coleta de dados.

Muitos acreditam que soluções simples, como usar um único IP ou proxies gratuitos, resolvem o problema. A verdade é que esses métodos frequentemente provocam bloqueios e perda de dados importantes.

Neste artigo, vamos desvendar desde o que é um proxy até técnicas avançadas como rotação automática de IPs e inteligência artificial para gerenciamento. Você vai entender como usar essas ferramentas para fazer scraping de forma segura, eficiente e otimizada.

O que é um proxy e por que é crucial para web scraping

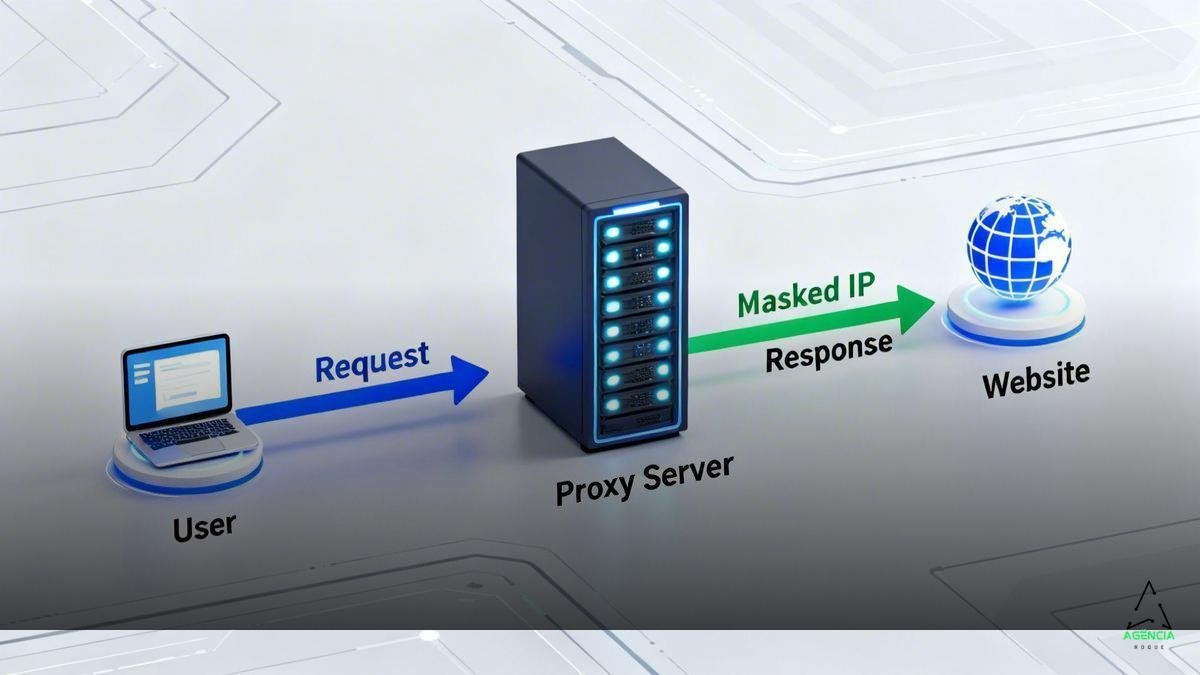

Um proxy é um servidor intermediário que conecta seu dispositivo à internet e ajuda a proteger sua identidade online. É fundamental para quem faz web scraping porque esconde o endereço IP real e evita bloqueios nos sites visitados.

Definição simples e objetiva de proxy

Proxy é um servidor que atua como uma ponte entre você e a internet. Ele recebe seus pedidos e os encaminha usando seu próprio IP, escondendo quem você realmente é.

Pense no proxy como um filtro protetor, que adiciona uma camada extra de anonimato e segurança para suas conexões.

Diferença entre proxy e VPN

Proxy não criptografa seus dados, ele apenas esconde seu IP e redireciona o tráfego. Já uma VPN faz isso e também adiciona uma proteção extra ao criptografar toda a sua conexão.

Então, enquanto a VPN garante mais segurança, o proxy é mais usado para tarefas específicas como web scraping devido à sua simplicidade.

Papel do proxy em web scraping

Proxy ajuda a evitar bloqueios em sites e permite fazer várias requisições sem ser detectado. Ele redireciona as solicitações, criando várias identidades online.

Isso é essencial para coletar dados em grande escala, pirando menos os sistemas que tentam impedir acessos repetitivos.

Tipos de proxy usados em web scraping e suas funções

Existem vários tipos de proxy usados no web scraping, cada um com uma função diferente para driblar bloqueios e otimizar a coleta de dados.

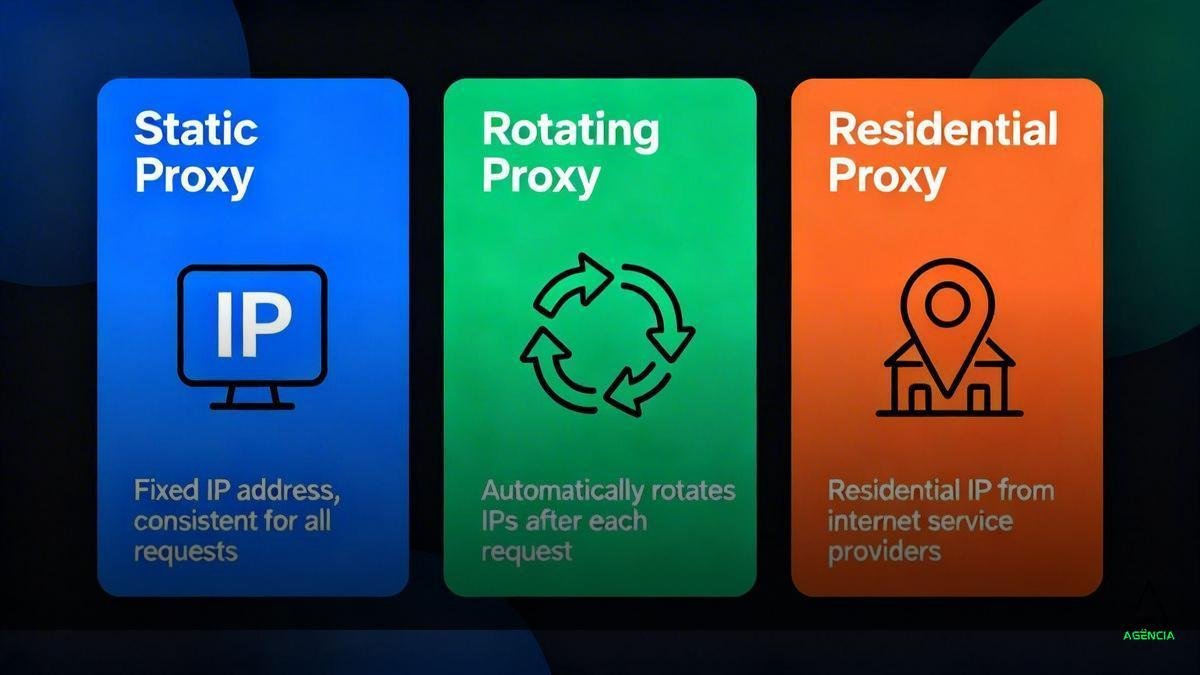

Proxy estático vs. rotativo

Proxy estático usa um IP fixo, bom para sessões longas, mas pode ser fácil de bloquear. Já o proxy rotativo troca o IP automaticamente, distribuindo as requisições para evitar limitações e bloqueios.

Ferramentas como Scrapy e Apify usam proxies rotativos para gerenciar grandes volumes de dados, garantindo velocidade e segurança.

Proxies residenciais e datacenter

Proxies residenciais vêm de IPs reais de provedores de internet, parecendo acessos legítimos. Proxies datacenter são rápidos e baratos, vindos de centros de dados, mas são mais fáceis de serem detectados e bloqueados.

Resumindo, os residenciais simulam usuários reais e são melhores contra bloqueios geográficos e sistemas de segurança.

Quando usar cada tipo de proxy

Use proxies datacenter para tarefas rápidas e de baixo custo, como pesquisas simples. Proxies residenciais são ideais para acessar conteúdos bloqueados ou que exigem alto anonimato.

Para grandes volumes, sempre prefira proxies rotativos para evitar ser banido por excesso de requisições.

Como funciona a rotação de IPs para evitar bloqueios

A rotação de IPs é essencial para evitar que sites detectem e bloqueiem acessos repetidos durante web scraping. Ela alterna os endereços IP usados, simulando usuários diferentes e espalhando requisições.

Por que os sites bloqueiam acessos repetidos

Sites bloqueiam IPs por excesso de requisições, atividades automáticas e violações. Isso protege contra ataques e preveni uso abusivo. Bloqueios podem ser permanentes e rastreamentos usam cookies e fingerprints.

Por exemplo, atualizar páginas rapidinho ou usar Wi-Fi público pode indicar bot.

Como o proxy rotativo engana os sites

Proxy rotativo troca o IP automaticamente a cada pedido, fingindo que diferentes pessoas acessam o site de várias localidades.

Ferramentas junto com antidetect criam novos perfis, evitando a detecção por padrões repetidos.

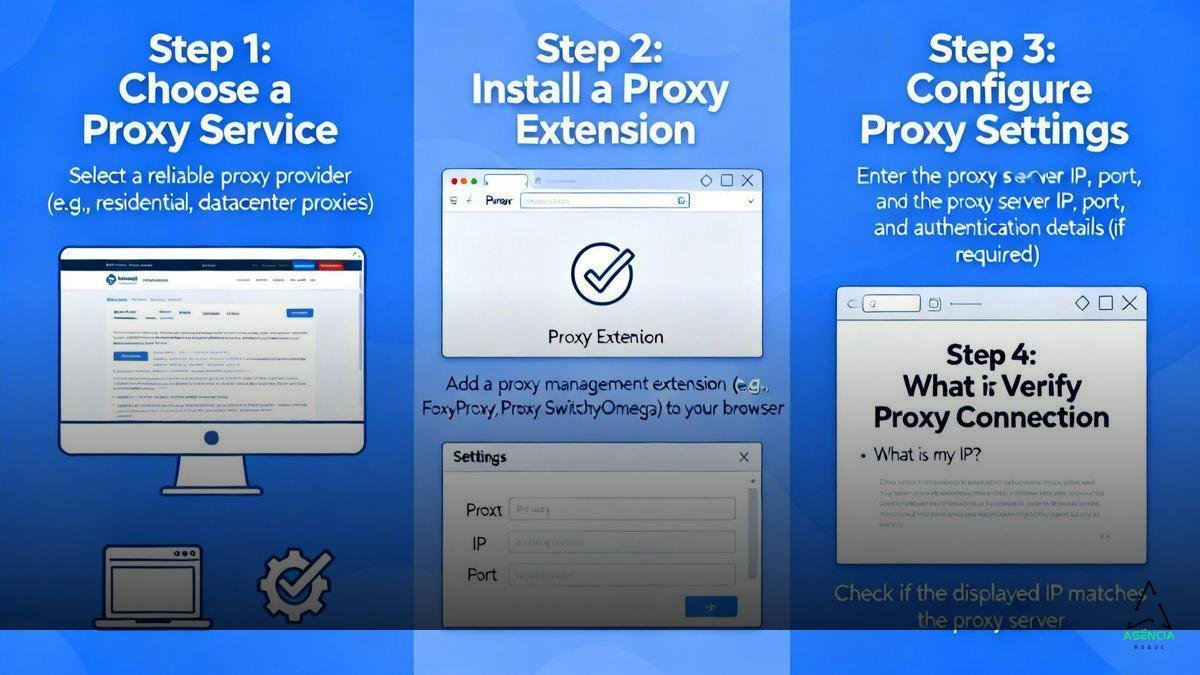

Configuração prática da rotação de IPs

Proxies residenciais rotativos são recomendados e podem ser usados com softwares que mudam o IP por sessão. Também dá para reiniciar o roteador para IP dinâmico ou alternar redes.

Scripts que automatizam isso via API ajudam na prática, sempre combinando rotação de user-agents para melhor resultado.

Riscos comuns e limitações do uso de proxy em scraping

Embora proxies ajudem no scraping, eles têm riscos e limitações que podem atrapalhar a coleta de dados.

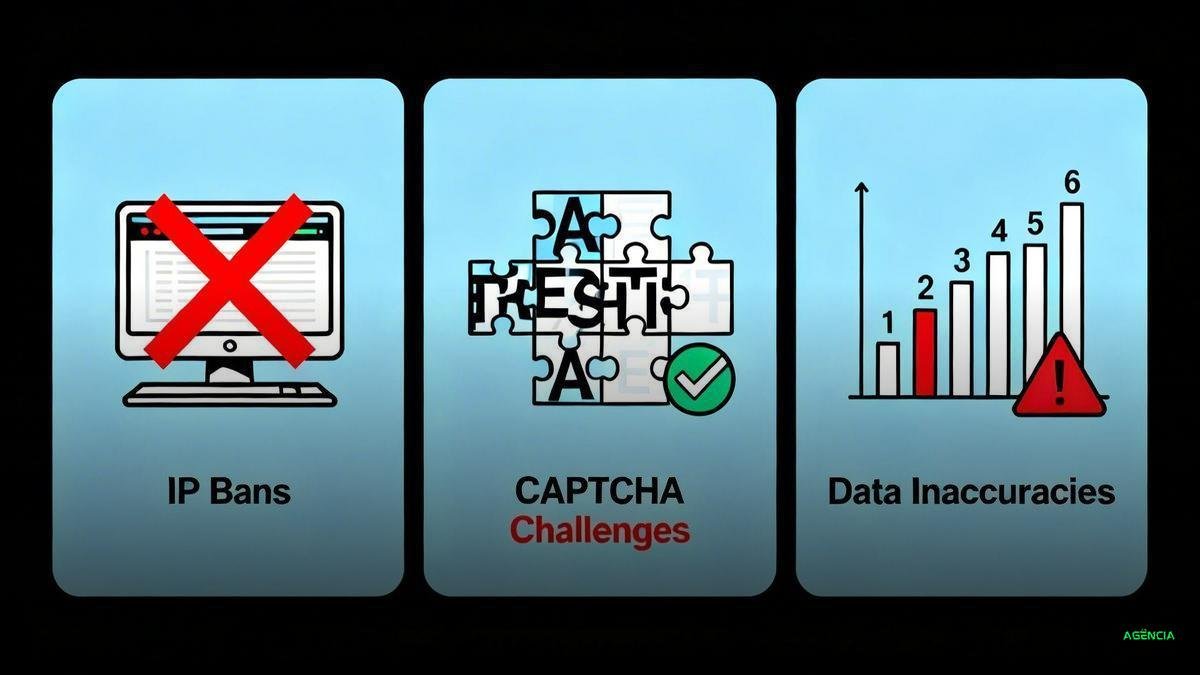

Bloqueios e CAPTCHAs frequentes

Bloqueios e CAPTCHAs são problemas comuns que ocorrem quando sites detectam acessos automáticos em excesso. Eles interrompem o scraping e exigem soluções extras para seguir coletando dados.

Muitos sites usam CAPTCHAs para garantir que um humano está acessando, o que frustram bots simples.

Dados imprecisos e delays

Proxies podem causar atrasos e dados incompletos por causa da latência e bloqueios parciais. Isso resulta em dados fora de sincronia ou até corrompidos, impactando análises.

Mesmo com proxy, algumas páginas demoram a carregar ou não retornam todas as informações.

Limitações técnicas do proxy

Há limites nos proxies, como IPs bloqueados e tráfego restrito. Proxies gratuitos, por exemplo, tendem a ser lentos ou pouco confiáveis.

Além disso, proxies não previnem todas as formas de bloqueio, como fingerprinting avançado ou verificação de comportamento.

Ferramentas e tecnologias avançadas para proxy em web scraping

Ferramentas avançadas tornaram o uso de proxies em web scraping mais inteligente, rápido e eficiente, especialmente com IA e nuvem.

IA adaptativa para proxy

IA adaptativa ajusta automaticamente a rotação de IPs e estratégias conforme o site, minimizando bloqueios e aumentando a eficácia.

Plataformas como Multilogin criam perfis únicos com variações constantes de fingerprint e IP para driblar detecções.

Soluções em nuvem para scraping

Serviços em nuvem combinam proxy rotativo e automação para facilitar scrapings em larga escala, com escalabilidade e gerenciamento simplificado.

Brightdata e Octoparse são exemplos que permitem múltiplos IPs e acessos sem bloqueio.

Automação de resolução de CAPTCHAs

Softwares com IA resolvem CAPTCHAs automaticamente, evitando pausas e perdas de dados no scraping.

Isso é crucial para contornar as proteções mais sofisticadas dos sites e garantir a continuidade do processo.

Melhores práticas para configuração e uso de proxy em scraping

Usar proxies corretamente é a chave para sucesso em web scraping. Vamos ver as melhores práticas para evitar erros e garantir resultados consistentes.

Velocidade ideal de requisições

Manter uma velocidade controlada evita bloqueios e suspensões. O ideal é fazer entre 1 a 5 requisições por segundo, simulando o comportamento humano.

Requisições rápidas demais despertam alertas e podem levar a banimentos.

Distribuição inteligente de IPs

Distribuir requisições entre vários IPs ajuda a evitar marcas e bloqueios. Proxies rotativos combinados com diferentes user agents aumentam as chances de sucesso.

Um pool de ≥100 IPs garante diversidade suficiente para grandes volumes.

Monitoramento e manutenção constante

Monitorar o desempenho do proxy e atualizar listas regularmente previne surpresas. Remover IPs bloqueados e ajustar a configuração são essenciais para manter a operação fluida.

Ferramentas de automação ajudam a identificar falhas e otimizar rotas.

Estudo de caso: Sucesso com proxy para web scraping

Vamos analisar um estudo de caso real que mostra como usar proxies pode transformar uma estratégia de web scraping, trazendo resultados expressivos e aprendizado valioso.

Exemplo real de empresa

Uma startup de análise de mercado implementou proxies rotativos para coletar dados de concorrentes sem ser bloqueada.

Antes, eles enfrentavam contantes bloqueios, o que atrasava projetos e causava perda de dados.

Resultados obtidos

Após o uso de proxies rotativos, a empresa aumentou a coleta em 70%, reduzindo erros em 85% por bloqueios e quedas.

O scraping passou a ser feito em múltiplas localidades simultaneamente, agilizando relatórios e insights.

Aprendizados e dicas finais

Estimule a diversificação e monitore desempenho. Aprender a combinar proxies residenciais e rotativos ajudou a equilibrar custo e eficiência.

Também perceberam a importância da manutenção constante para evitar IPs banidos e garantir estabilidade.

Conclusão do artigo

O uso de proxies é fundamental para quem deseja fazer web scraping de forma eficiente e segura. Eles ajudam a evitar bloqueios e a manter o anonimato, facilitando o acesso a grandes volumes de dados.

Ao longo do artigo, vimos que existem vários tipos de proxies, como os estáticos, rotativos, residenciais e de datacenter, cada um com suas funções específicas. A escolha correta depende do objetivo e do tipo de scraping que você pretende realizar.

Também descobrimos que a rotação de IPs é uma técnica chave para enganar sistemas de bloqueio e garantir o fluxo contínuo das requisições. Junto disso, as tecnologias avançadas, como a IA adaptativa e a automação na resolução de CAPTCHAs, ampliam as possibilidades e a eficácia.

Importa lembrar que o sucesso no uso do proxy depende de boas práticas. Isso inclui limitar a velocidade das requisições, distribuir corretamente os IPs e manter uma monitoramento constante para evitar falhas. Com essa estratégia, o web scraping pode se tornar uma ferramenta poderosa e confiável.

Key Takeaways

Descubra as estratégias e práticas essenciais para usar proxies de forma eficiente em web scraping e evitar bloqueios.

- O que é um proxy: Proxy atua como intermediário, ocultando seu IP real para maior anonimato e segurança nas requisições.

- Tipos de proxy: Estáticos são bons para sessões longas, rotativos ideais para alto volume e prevenção de bloqueios.

- Proxies residenciais vs. datacenter: Residenciais simulam usuários reais, minimizando bloqueios; datacenter são rápidos e baratos, mas mais vulneráveis.

- Rotação de IPs: Alternar IPs evita bloqueios por acessos repetidos e reduz chances de detecção por sites.

- Riscos comuns: Bloqueios frequentes, CAPTCHAs, dados imprecisos e limitações técnicas exigem soluções complementares para garantir eficácia.

- Tecnologias avançadas: IA adaptativa e automação de CAPTCHAs aumentam a eficiência e contornam mecanismos de proteção mais sofisticados.

- Boas práticas: Mantenha velocidade controlada nas requisições, distribua IPs inteligentemente e monitore constantemente para ajustes.

- Estudo de caso: Uso correto de proxies rotativos elevou em 70% a coleta de dados de uma startup, com 85% menos erros por bloqueios.

O sucesso no web scraping depende da escolha correta do proxy, automação inteligente e manutenção constante para garantir dados confiáveis e contínuos.